Примечание переводчика: это перевод статьи Джуди Ханвен Шен и Алекса Тэмкина, опубликованной в исследовательском блоге Anthropic 29 января 2026 года. Все права на оригинал принадлежат авторам. Перевод размещён для удобства чтения и обсуждения; настоятельно рекомендую прочитать оригинал на anthropic.com.

Исследования показывают, что ИИ помогает людям выполнять часть рабочих задач быстрее. В наблюдательном исследовании на данных Claude.ai мы обнаружили, что ИИ может ускорять отдельные задачи на 80%. Но не приходится ли за этот рост производительности чем-то платить? Другие работы показывают, что при использовании ИИ-ассистента люди меньше вовлекаются в работу и прикладывают меньше усилий — иначе говоря, перекладывают мышление на ИИ.

До сих пор не было ясно, мешает ли такая «когнитивная разгрузка» развитию навыков на работе — а в случае разработки ещё и пониманию тех систем, которые человек собирает. Наше новое исследование — рандомизированный контролируемый эксперимент с участием программистов — изучает именно эту потенциальную обратную сторону работы с ИИ.

У вопроса широкие следствия: от того, как проектировать ИИ-продукты, способствующие обучению, до того, какую политику в отношении ИИ выстраивать в компаниях, и как в целом сохранить устойчивость общества. Мы сосредоточились на программировании — области, в которой ИИ-инструменты уже стали стандартом. И здесь возникает напряжение: чем сильнее код автоматизируется и чем быстрее идёт работа, тем важнее, чтобы у людей оставались навыки замечать ошибки, направлять результат и в конечном счёте контролировать ИИ в ответственных средах. Даёт ли ИИ короткий путь одновременно и к развитию навыков, и к росту эффективности? Или прирост производительности из-за ИИ подрывает развитие навыков?

В рандомизированном контролируемом эксперименте мы изучили: 1) насколько быстро программисты осваивают новый навык (в нашем случае — Python-библиотеку) с ИИ-ассистентом и без него; и 2) хуже ли они понимают код, который только что написали, если им помогал ИИ.

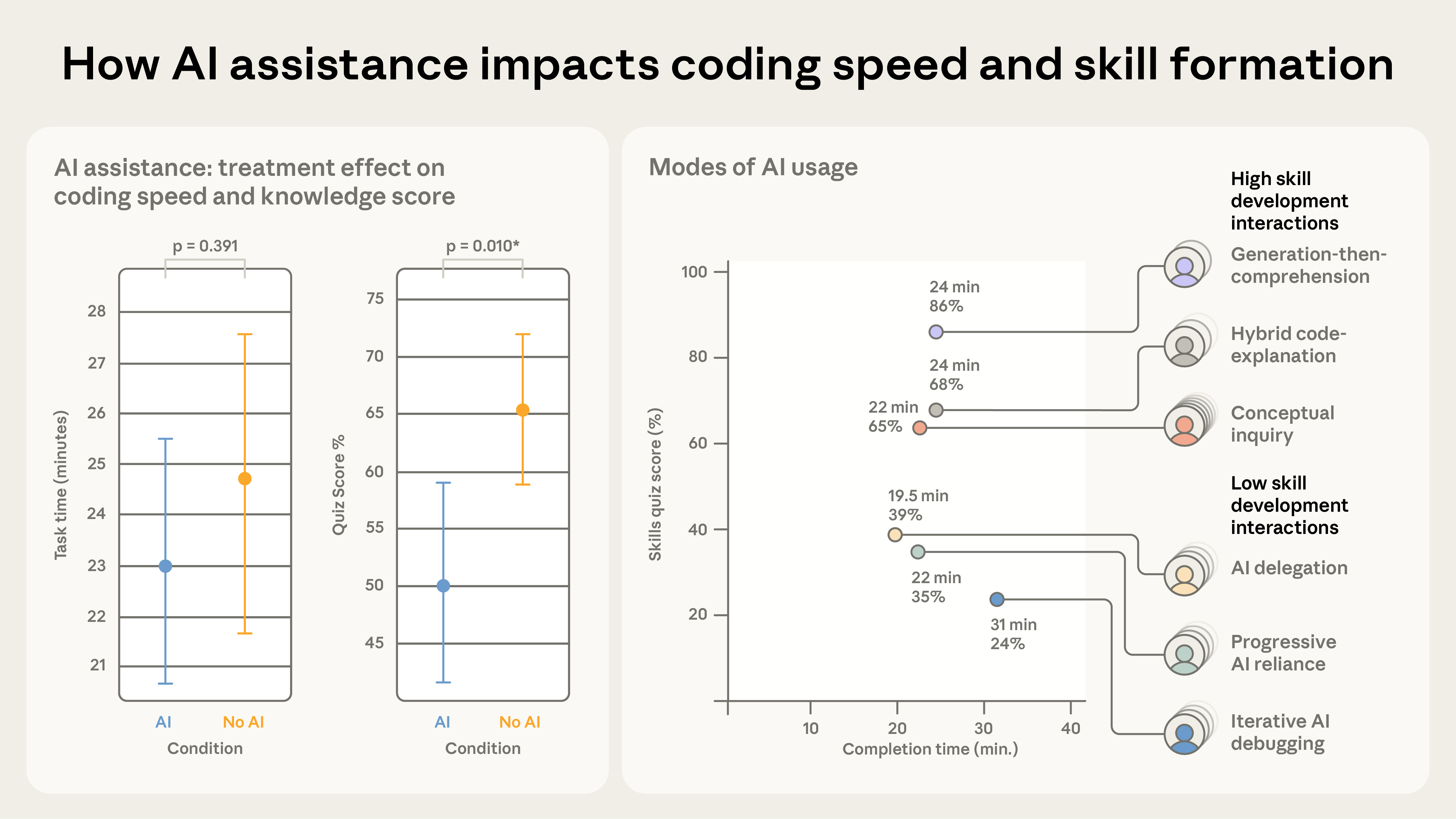

Мы обнаружили, что использование ИИ-ассистента приводит к статистически значимому снижению уровня владения материалом. На тесте, который проверял понятия, использованные участниками всего за несколько минут до этого, группа с ИИ показала результаты на 17% ниже, чем те, кто писал код руками — это эквивалент почти двух буквенных оценок. ИИ слегка ускорил выполнение задачи, но эта разница не достигла статистической значимости.

Важно: использование ИИ не гарантировало низкого результата. Имело значение, как именно человек использовал ИИ. Те, кто показал лучшее понимание, использовали ИИ не только для генерации кода, но и для построения понимания по ходу — задавали уточняющие вопросы, просили объяснений, задавали концептуальные вопросы, продолжая писать код самостоятельно.

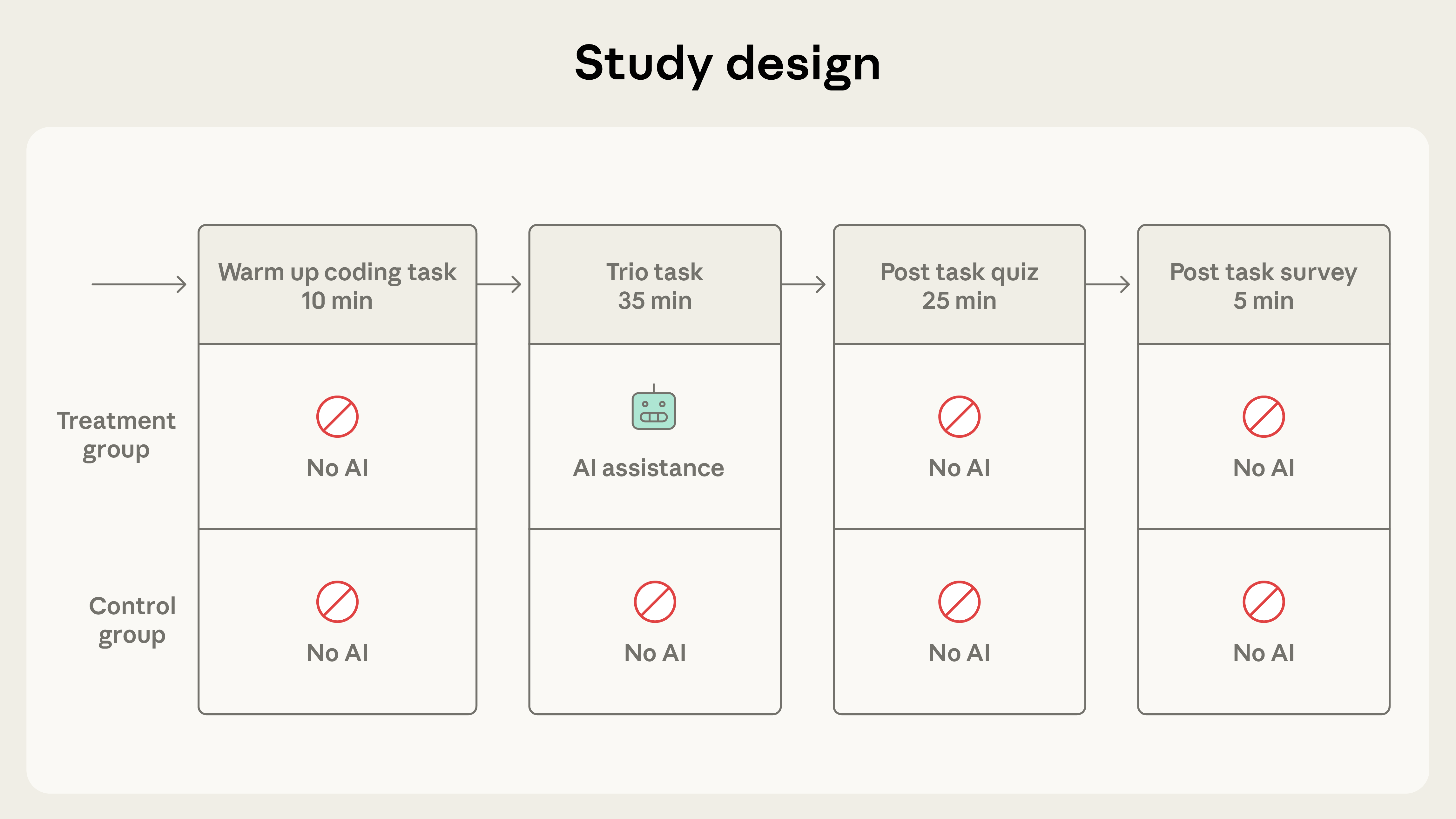

Дизайн исследования

Мы набрали 52 (преимущественно junior) разработчика, каждый из которых использовал Python хотя бы раз в неделю на протяжении более года. Мы также убедились, что участники хотя бы немного знакомы с ИИ-ассистентами в программировании, но не знакомы с Trio — Python-библиотекой, на которой строились задания.

Эксперимент был разделён на три части: разминка; основная задача — реализация двух разных функций с использованием Trio (что требует понимания концепций асинхронного программирования — навыка, который чаще всего осваивают уже на работе); и тест. Мы предупредили участников, что после задания будет тест, но призывали работать как можно быстрее.

Задание было спроектировано так, чтобы имитировать самостоятельное освоение нового инструмента по туториалу. Каждый участник получал описание задачи, стартовый код и краткое объяснение тех концепций Trio, которые понадобятся для решения. Мы использовали онлайн-платформу для написания кода, в которой сбоку был ИИ-ассистент с доступом к коду участника — он мог в любой момент по запросу выдать готовое корректное решение.1

Дизайн оценивания

Разрабатывая систему оценивания, мы опирались на исследования в области образования по computer science и выделили четыре типа задач, которыми обычно оценивают владение навыками программирования:

- Отладка. Способность находить и диагностировать ошибки в коде. Этот навык критичен, чтобы замечать, когда сгенерированный ИИ код некорректен, и понимать, почему он не работает.

- Чтение кода. Способность читать и понимать, что делает код. Этот навык позволяет человеку понимать и проверять код, написанный ИИ, до того как он попадёт в продакшн.

- Написание кода. Способность написать или выбрать корректный подход к решению. Низкоуровневое написание кода — например, помнить синтаксис функций — будет всё менее важным по мере дальнейшей интеграции ИИ-инструментов; в отличие от высокоуровневого проектирования систем.

- Концептуальный уровень. Способность понимать ключевые принципы, лежащие в основе инструментов и библиотек. Концептуальное понимание необходимо, чтобы судить, использует ли сгенерированный ИИ код подходящие шаблоны проектирования и соответствует ли он замыслу библиотеки.

Основной упор в нашем оценивании пришёлся на отладку, чтение кода и концептуальные вопросы — мы считали именно их наиболее важными для контроля над кодом, который всё чаще будет писаться ИИ.

Результаты

В среднем участники из ИИ-группы заканчивали задание примерно на две минуты быстрее, но эта разница не была статистически значимой. Зато была значимой разница в результатах теста: ИИ-группа в среднем набрала 50%, тогда как группа ручного кода — 67%, что эквивалентно почти двум буквенным оценкам (Cohen’s d = 0.738, p = 0.01). Самый большой разрыв между группами обнаружился в задачах на отладку — это намекает, что именно способность понимать, где код некорректен и почему он падает, может особенно страдать, если ИИ препятствует развитию навыка.

Качественный анализ: режимы взаимодействия с ИИ

Нам было особенно интересно понять, как именно участники подходили к решению задач. В качественном анализе мы вручную размечали записи экранов, фиксируя, сколько времени участники тратили на формулировку запросов, какого типа вопросы задавали, какие совершали ошибки и сколько времени активно писали код.

Один из неожиданных результатов — насколько много времени участники проводили в общении с ИИ. Некоторые тратили до 11 минут (30% от всего отведённого времени), формулируя до 15 запросов. Это отчасти объясняет, почему в среднем те, кто пользовался ИИ, заканчивали быстрее, но прирост производительности оказался статистически незначимым. Мы предполагаем, что ИИ значительнее ускоряет работу на повторяющихся или знакомых задачах.

Ожидаемо, участники из группы без ИИ сталкивались с большим числом ошибок. Среди них были как синтаксические ошибки, так и ошибки в концепциях Trio — и именно последние напрямую соответствовали темам, проверявшимся на тесте. Наша гипотеза: участники, которые столкнулись с большим числом ошибок Trio (то есть контрольная группа), скорее всего прокачали навык отладки, разрешая эти ошибки самостоятельно.

Затем мы сгруппировали участников по тому, как они взаимодействовали с ИИ, и выделили различные паттерны, ведущие к разным результатам — и по времени выполнения, и по обучению.

Паттерны с низкими баллами в основном предполагали сильную опору на ИИ — либо при генерации кода, либо при отладке. Средний балл в этой группе — менее 40%. Меньше самостоятельного мышления и больше когнитивной разгрузки. Внутри неё мы выделили:

- Делегирование ИИ (n = 4). Эти участники полностью полагались на ИИ при написании кода и решении задачи. Они справились быстрее всех и почти не сталкивались с ошибками.

- Постепенное соскальзывание к ИИ (n = 4). Сначала задавали один-два вопроса, а потом полностью передавали написание кода ассистенту. Низкий результат на тесте — в основном из-за того, что не освоили ни одной из концепций второго задания.

- Итеративная отладка с ИИ (n = 4). Полагались на ИИ, чтобы отладить или проверить свой код. Задавали больше вопросов, но опирались на ассистента в решении проблем, а не в прояснении собственного понимания. Как следствие — низкий балл и более медленное выполнение обеих задач.

Паттерны с высокими баллами мы определили как те, в которых средний балл на тесте — 65% и выше. Участники в этих кластерах использовали ИИ и для генерации кода, и для концептуальных вопросов.

- Сначала генерация — потом понимание (n = 2). Сначала генерировали код, копировали или вставляли его в работу, а уже после этого задавали ассистенту уточняющие вопросы, чтобы лучше его понять. Такие участники не были особенно быстрыми, но показали более глубокое понимание на тесте. Любопытно, что внешне их подход почти не отличался от группы «делегирования ИИ» — за исключением того, что они использовали ИИ как способ проверить собственное понимание.

- Гибрид «код + объяснение» (n = 3). Формулировали гибридные запросы: просили сгенерировать код вместе с пояснением. Чтение и осмысление этих пояснений требовало больше времени, но помогало понять материал.

- Концептуальный режим (n = 7). Задавали ИИ только концептуальные вопросы, а решение писали сами, опираясь на улучшенное понимание. Эта группа сталкивалась со многими ошибками, но решала их самостоятельно. В среднем это был самый быстрый режим среди высокобалльных и второй по скорости в целом — после полного делегирования.

Качественный анализ не доказывает причинно-следственной связи между паттерном взаимодействия и результатом обучения, но указывает на поведения, ассоциированные с разными исходами.

Выводы

Наши результаты указывают на то, что агрессивное внедрение ИИ в рабочую среду, особенно в инженерии ПО, сопряжено с компромиссами. Не всякая опора на ИИ одинакова: то, как именно мы взаимодействуем с ИИ в погоне за эффективностью, влияет на то, чему мы при этом учимся. В условиях временных ограничений и организационного давления junior-разработчики (и не только) могут полагаться на ИИ, чтобы выполнять задачи как можно быстрее — за счёт развития навыков, и в первую очередь способности отлаживать, когда что-то идёт не так.

Хотя результаты предварительные, они задают важные вопросы по мере того, как компании переходят к всё большему соотношению «ИИ-код к человеческому коду». Прирост в производительности может прийти за счёт навыков, нужных для проверки кода, написанного ИИ — особенно если развитие этих навыков у junior-инженеров было заторможено самим использованием ИИ. Менеджерам стоит осознанно подходить к развёртыванию ИИ-инструментов в масштабе и продумывать системы или специальные дизайн-решения, гарантирующие, что инженеры продолжают учиться по ходу работы — и потому остаются способны осмысленно контролировать те системы, которые они строят.

Для начинающих специалистов в инженерии ПО — и в любой другой отрасли — наше исследование можно считать небольшим, но конкретным аргументом в пользу осознанного развития навыков при работе с ИИ. Когнитивное усилие — и даже мучительное «застревание» — по-видимому, важно для формирования мастерства. Этот же урок применим и к тому, как каждый из нас выбирает работать с ИИ и какими инструментами пользуется. Крупные LLM-сервисы предлагают и режимы обучения (например, Learning и Explanatory mode в Claude Code или Study Mode в ChatGPT), специально созданные для того, чтобы способствовать пониманию. Понимание того, как люди учатся с ИИ, может также направлять и то, как мы его проектируем: ИИ-помощь должна позволять людям работать эффективнее и одновременно развивать новые навыки.

Прежние исследования давали смешанные результаты в вопросе, помогает ли ИИ продуктивности в программировании или мешает ей. Наше же предыдущее исследование показало, что ИИ может сокращать время выполнения некоторых рабочих задач на 80% — что может показаться противоречием с нынешними выводами. Но эти два исследования отвечают на разные вопросы и используют разные методы: предыдущая наблюдательная работа измеряла продуктивность на задачах, где у участников уже были нужные навыки; нынешнее же изучает, что происходит, когда человек учится чему-то новому. Возможно, ИИ одновременно ускоряет работу на уже освоенных навыках и тормозит освоение новых — но чтобы понять эту связь, нужны дальнейшие исследования.

Это исследование — лишь первый шаг в попытке разобраться, как сотрудничество человека и ИИ влияет на опыт работника. Наша выборка относительно невелика, а оценивание измеряло понимание сразу после кодирования. Предсказывают ли результаты теста сразу после задания долгосрочное развитие навыка — это важный вопрос, на который текущая работа не отвечает. Остаётся много открытых вопросов, которые мы надеемся увидеть в будущих исследованиях: например, влияние ИИ на задачи за пределами программирования; рассеивается ли этот эффект в долгосроке по мере того, как инженеры обретают большее владение; и отличается ли ИИ-помощь от человеческой помощи в процессе обучения.

В конечном счёте, чтобы вписать развитие навыков в мир ИИ, нам нужен более широкий взгляд на влияние ИИ на людей. В рабочей среде, дополненной ИИ, важен и прирост производительности, но не менее важно и долгосрочное развитие той экспертизы, на которой этот прирост держится.

Подробности — в полной статье на сайте Anthropic.

Footnotes

-

Важно: эта схема отличается от агентных продуктов вроде Claude Code; мы ожидаем, что эффекты таких систем на формирование навыков, скорее всего, будут более выраженными, чем результаты, представленные здесь. ↩